GoogleNet[szegedy et al., 2014]

네트워크가 깊고 넓을수록 학습이 성능이 좋아질 것이라 생각.

네트워크가 너무 깊으면

1.모델 구조에 대한 연구

2.backpropagation을 효율적으로 전달하기 위한 연구

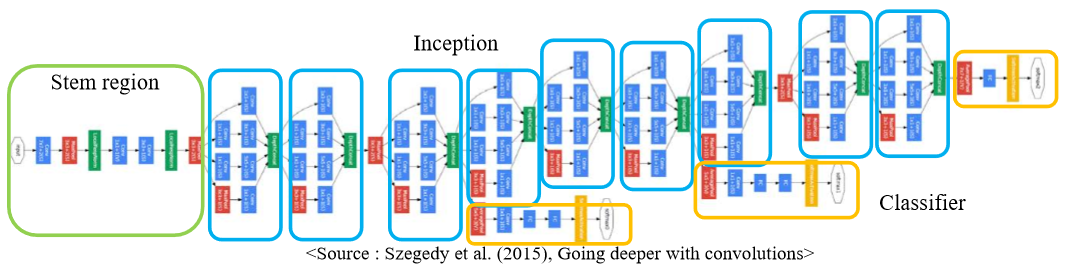

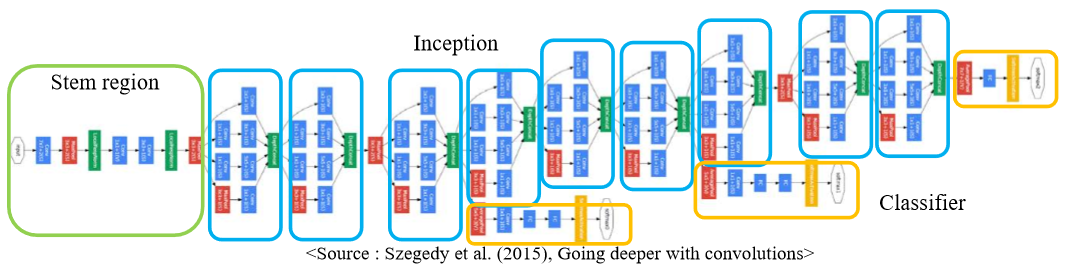

전체적으로 보면 inception module의 덩어리로 이루어진 구조

맨 앞부분 - inception module로 들어가기 위해 정제되는 부분

맨 뒷부분 - inception module로 정제된 output을 최종 결과로 만들어 주는 부분

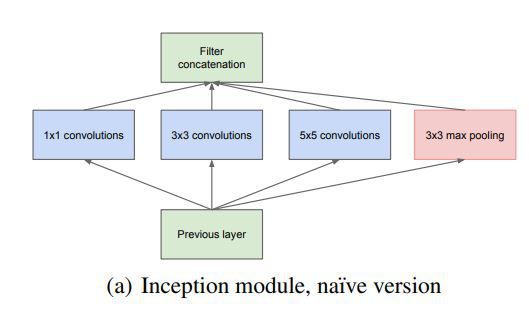

inception module

다양한 크기의 filter를 이용하지만 연산량이 증가하므로 비효율적인 결과를 가져온다.

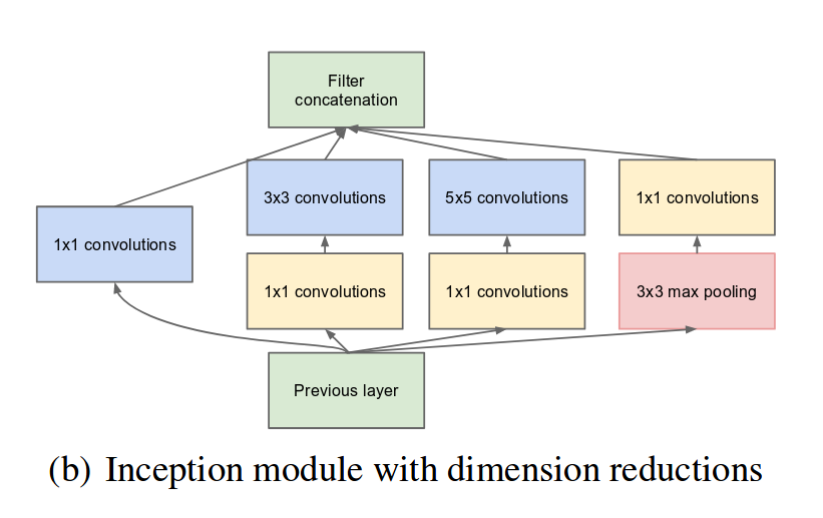

1*1filter가 추가된 수정된 version의 inception module

previous layer에서 input을 받아 4갈래로 나뉘어 연산이 진행.

4개의 feature map들을 concatenate함 >> (작은크기의 feature & 중간크기의 feature & 큰 크기의 feature & 이전 layer의 중요한 특징만 뽑아낸 feature)

1*1 convolution 의 효과